Zdroj: BBC

Nově zveřejněné výpovědi takzvaných whistleblowerů odhalují pozadí toho, jak největší giganti v oblasti sociálních sítí – Meta a TikTok, bojují o pozornost uživatelů. Podle výpovědí záměrně upravovali své algoritmy tak, aby lidem servírovali škodlivý a vysoce návykový obsah. Důvod? Klesající akcie a snaha dohnat konkurenci. Zatímco se vedení firem veřejně chlubí ochranou mladistvých, v zákulisí přitom jde především o politiku a růst tržeb.„“

Algoritmus jako nástroj pro šíření zla na sítích TikTok a Meta

Podle interních dokumentů společnosti Meta, které získala stanice BBC, si byl Facebook vědom toho, že své uživatele „krmí“ škodlivým, nebo chceme-li, toxickým obsahem, který je pro mnohé uživatele vysoce návykový. Problém je v tom, že tento obsah v podobě šíření nenávistných komentářů a konspirací vyvolává okamžitou reakci dalších uživatelů. Každý z nás jistě zažil to, že mu algoritmus nabídl nějaký příspěvek s ožehavým, či třaskavým tématem. Jedním takovým může být například politicky orientovaný obsah. Lidé na takové téma reagují a zapojují se do diskuzí ve kterých to obvykle vře jako v pekelném kotli. Algoritmus si pak reakce lidí, byť vesměs negativní, vyloží jako zájem a servíruje toho uživateli ještě víc.

Za vším hledejme tajemné slovo „Algoritmus“

Bývalý výzkumník společnosti Meta Matt Motyl popsal, že Instagram Reels, což je sekce, kde uživatelé naleznou nekonečný výběr krátkých videí a která je přímý konkurent TikToku, vznikl v roce 2020 bez dostatečného bezpečnostního mechanismu.

Matt Motyl uvedl, že společnost Meta spustila Instagram Reels bez dostatečných bezpečnostních opatření, zdroj: BBC

Data ukazují, že šikana a obtěžování jsou v sekci krátkých videí o 75 % častější než ve zbytku Instagramu. Když však bezpečnostní týmy žádaly o posílení ochrany dětí, vedení je odmítlo. Místo toho investovalo do 700 nových zaměstnanců, jejichž jediným úkolem bylo zajistit růst sekce Reels.

Vývojáři a další zaměstnanci, kteří takový algoritmus vyvíjejí, přirovnávají svou práci k vývoji auta. Jedni se starají o motor a zrychlení, druzí o brzdy. Ruofan Ding, který vyvíjel doporučovací systém TikToku, však přiznává, že nad samotným procesem hlubokého učení nemají vývojáři plnou kontrolu. Obsah je pro ně jen anonymními daty v databázi.

Pokud selže tým, který má na starosti „brzdy“ – tedy moderování obsahu – algoritmus začne nekontrolovaně zrychlovat i u příspěvků, které jsou takzvaně za hranou. Jde o takzvaný „borderline“ obsah, který zahrnuje rasismus, misogynii nebo dezinformace. Informátor z Mety potvrdil, že management přímo nařídil tento škodlivý obsah do uživatelských feedů uvolňovat. Cílem bylo zvýšit zapojení a zastavit pád cen akcií.

Politici mají přednost před zneužívanými dětmi

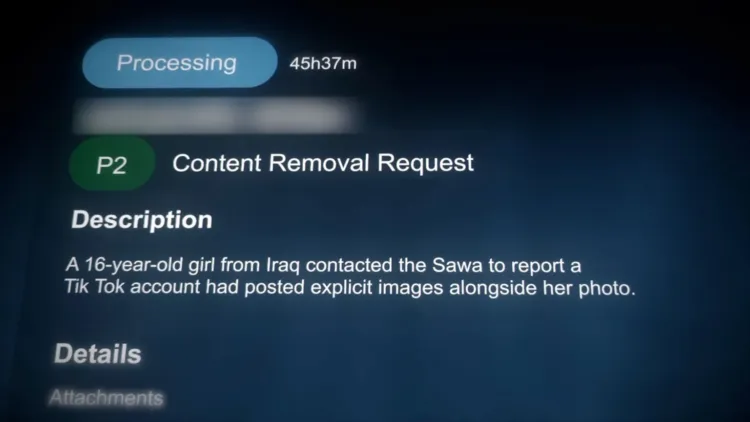

Šokující svědectví přinesl také jeden zaměstnanec TikToku. Ten redaktorům BBC ukázal interní systémy firmy, kde jsou stížnosti uživatelů řazeny podle priorit. Ukázalo se, že banální případy, kdy si někdo dělal legraci z politika, měly vyšší prioritu než hlášení o sexuálním vydírání nezletilých.

Vnitřní systémy aplikace TikTok označily některé závažné případy týkající se dětí jako P2 – tedy s nižší prioritou, zdroj: BBC

Například případ sedmnáctileté dívky z Francie, která čelila kyberšikaně, nebo šestnáctileté dívky z Iráku, jejíž intimní fotografie někdo šířil na síti, dostaly štítek „nízká naléhavost“. Proč? Podle tohoto zaměstnance se TikTok více bojí regulací a zákazů ze strany vlád než dopadů na psychiku dětí. Snaha udržet si dobré vztahy s politiky tak přímo ohrožuje ty nejzranitelnější.

Důsledky toho, jak jsou algoritmy na sociálních sítích nastaveny jsou reálné a ničivé. Devatenáctiletý Calum popsal, jak ho algoritmus od čtrnácti let postupně radikalizoval. Začalo to videi, která v něm vyvolávala hněv a pocit nespravedlnosti. Postupem času se dle jeho slov díky algoritmu dostával více a více do pomyslné bubliny rasismu a nenávisti k ženám. „Ta videa mě nabíjela energií, ale ne v dobrém slova smyslu. Cítil jsem jen obrovský vztek na lidi kolem sebe,“ sdělil Calum.

Podle britské protiteroristické policie dochází v posledních měsících k nebezpečné normalizaci násilných a extremistických postojů. Lidé jsou vůči násilí v reálném světě stále více otupělí a nebojí se sdílet i ty nejradikálnější názory, protože jim k tomu algoritmy zaměřené na „emoční angažovanost“ dávají prostor.

Jsou to jen vykonstruovaná obvinění?

Meta i TikTok se proti těmto tvrzením ostře ohrazují. Meta uvádí, že tvrzení o záměrném zesilování škodlivého obsahu pro zisk jsou lživá a že do bezpečnosti investuje miliardy dolarů. TikTok zase označil svědectví za „vykonstruovaná“ a zdůraznil, že pro teenagery nabízí desítky bezpečnostních prvků, které jsou v aplikaci automaticky zapnuté.

Pravda však zůstává skryta hluboko v kódu algoritmu. Tento kód bohužel nikdo zvenčí nemůže zkontrolovat. Zatímco firmy prezentují své nástroje jako cestu k budování komunit, jako lepší propojení s přáteli a možnost být v obraze, svědectví zevnitř vykreslují obraz digitálního kolosea, kde je krev a hněv tou nejcennější měnou. Rada jednoho nejmenovaného informátora z TikToku mluví za vše a pro rodiče je jasným sdělením: „Smažte to. Držte od té aplikace své děti co nejdál a co nejdéle to půjde.“

Zdroj: bbc.com

Komentáře